通往人工智能的道路快速且充满盲点

可以说人工智能(AI)无处不在。报纸和杂志上充斥着有关由于AI和机器学习(ML)技术而推出的最新进展和新项目的文章。在过去的一年中,似乎所有必要的要素-强大,负担得起的计算机技术,先进的算法以及所需的大量数据-都融合在一起了。我们甚至在消费者,企业和监管机构之间都普遍接受这项技术。据推测,在未来几十年中,人工智能可能成为公司乃至整个国家的最大商业驱动力。

但是,对于任何新技术,在设计和使用方法上都必须考虑周全。组织还需要确保有人员来管理它,这通常是在急于实现预期收益的事后才想到的。

在赶上潮流之前,值得退后一步,更仔细地观察AI盲点可能在哪里发展,以及可以采取哪些措施来抵消它们。

缺少ML开发

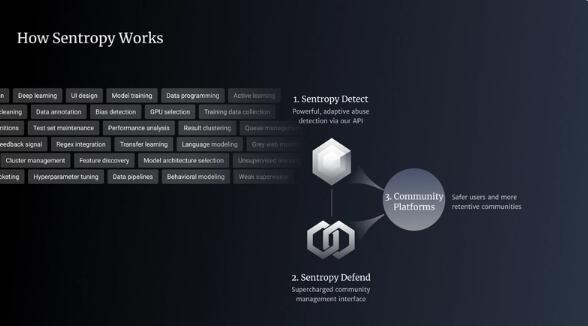

随着AI和ML的发展步伐加快,同时对网络犯罪的意识日益增强,组织必须确保他们考虑到任何潜在的责任。尽管如此,事实已经证明,对于开发人员在对他们的机器学习解决方案进行建模时,安全性,隐私和道德是低优先级的问题。尽管在机器学习开发中缺乏对安全性和隐私性关注的关注,但是大多数资源都集中在确保AI项目准确且成功上。例如,有55%的开发人员可以减轻意外结果或预测的影响,但仍有很多人仍然没有留下。此外,有16%的受访者在开发过程中根本没有检查任何风险。

尽职调查的缺乏可能是由于众多内部挑战和因素造成的,但是令人惊讶的是,这个问题的很大一部分是拥有完成开发过程中这些关键方面的技能和资源。实际上,技术中最长期的技能短缺集中在ML建模和数据科学上。为了在安全,隐私和道德方面取得进展,组织迫切需要解决此问题。

该怎么办?

去年,人工智能的成熟度和使用率呈指数增长。但是,仍然存在许多障碍,无法使其达到临界质量。为了确保AI和ML都能以大众为代表,并且可以安全地使用它们,组织需要采用某些最佳实践。

其中之一是确保构建AI模型的技术人员能够反映更广泛的人群。从数据集和开发人员的角度来看,这都可能很困难,尤其是在该技术处于起步阶段时。这意味着开发人员必须意识到与预期与这些系统进行交互的各种用户相关的问题,这一点至关重要。如果我们想创建适合所有人的AI技术-它们需要代表所有种族和性别。

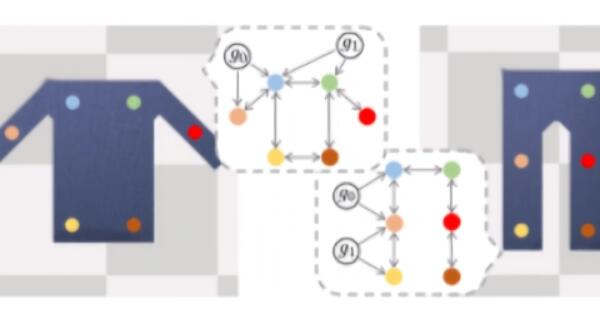

随着机器学习不可避免地变得越来越普及,对于公司而言,采用和超越该技术将变得越来越重要。机器学习,人工智能和数据驱动型决策的兴起意味着数据风险远远超出了数据泄露范围,现在包括删除和更改。对于某些应用程序,数据完整性可能最终使数据机密性黯然失色。